你在网上发的自拍,正被做成AV!AI技术遭滥用,众多明星惨遭“一键下海”(组图)

安迪·沃霍尔曾准确预言——

未来社会,每个人都可能在15分钟内出名。

透过这则预言,人们不得不承认安迪·沃霍尔的远见,毕竟在当年这听起来就是天方夜谭。但即便是安迪·沃霍尔,想象力也仍旧有限。

成名算什么?

如今社会,每个人都可能在一瞬间下海。

如今的 AI 技术有多强大呢?

上图这位演员,就是 2023 年 12 月日本某公司推出的首位 AI 女优——木花爱。

她的面部五官完全由 AI 生成,拍摄则由替身真人演员完成。影片录制结束后,仅需通过 AI 换脸技术,便能让木花爱收获一部新作品。

木花爱几乎是毫无破绽的。

如果你对其一无所知,大概率会认为这就是一位真实存在的、刚刚出道的 AV 女优。

成熟的 AI 技术,就是能做到如此天衣无缝。

聚光灯下,换脸出道的是木花爱。互联网的角落里,她可以是木花爱,也可以是我们任何一个人,包括正在读文章的你。

事实也正如此发展着——技术加持下,确有无数人正在被迫换脸出道,被动下海。不知觉间,甚至已有无数蛆虫藏在阴暗角落中看过「你的作品」。

AI 技术正在让普通人成为黄片主角,15 分钟成名的预言早已不再稀奇。

1 分钟速成 AV 主角,在这个时代都易如反掌。

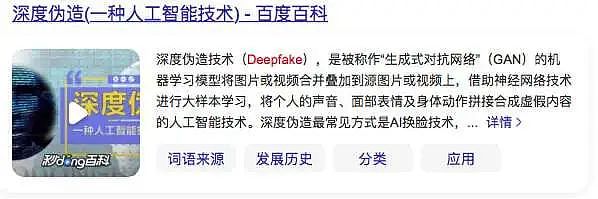

AI 换脸,并不是什么稀奇技术。

这项被命名为 deepfakes 的技术,人们早已见怪不怪。

早在 2019 年,就有人用 AI 换脸的技术让观众看到了有演技版的杨幂。

当年 B 站上一位 UP 主将 94 年版饰演黄蓉的朱茵,换脸成杨幂。

这段视频,一度被笑称为杨幂的演技巅峰。

彼时视频换脸技术,就已经相对成熟了,再配上技术过硬的人才,几乎没有破绽。

后来一些劣迹演员出事,被 AI 换脸成其他演员的例子也不胜枚举。

比如赵立新,剧组们排着队给他换脸。又是换黄志忠,又是换于震,又是换周一围......凭一己之力养活半数 AI 换脸的技术团队。

但人们不知道的是——

这项技术打从一开始,就是跑着出来拥抱色情产业的。

就连它命名本身,都是肮脏的。

2017 年《神奇女侠》的扮演者盖尔·加朵,突然卷入艳照门。

起因是一位名为 deepfakes 的用户,在 Reddit 网站上传的一段影片。影片中盖尔·加朵被推倒在床,继而开始一段情色视频的录制。

这段影片广泛传播后,开始有越来越多的女星被牵扯其中。

其中包括在《权力的游戏》中饰演艾莉娅的麦茜,《哈利波特》里饰演赫敏的艾玛·沃特森,以及泰勒·斯威夫特、斯嘉丽·约翰逊等等......围观者闻风而至,资源如病毒般疯狂扩散。

直到 deepfakes 被 Reddit 封杀,这场没有底线的网络强奸才总算告一段落。

彼时人们却不知道,这次封杀却是网络强奸的序幕。被封杀后的 deepfakes 直接开源了 AI 换脸项目的代码,从此这项技术变得唾手可得。

这个强奸犯的用户名,则被人们用来命名这项技术。

潘多拉魔盒,就此被打开。

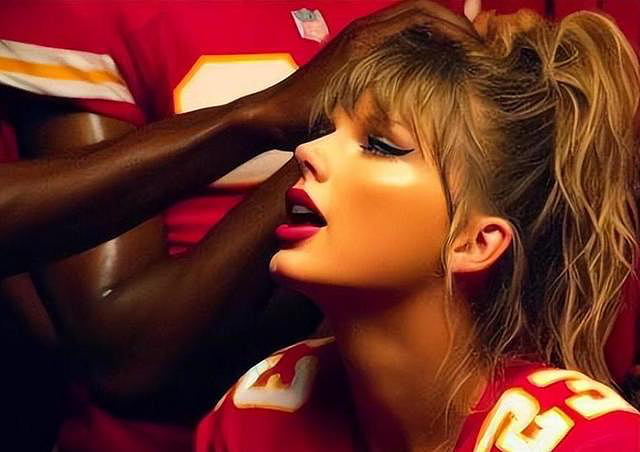

自 2017 年 AI 换头视频起,泰勒·斯威夫特就是 AI 技术的最大受害者。

今年 1 月,她的 AI 裸照再次在社交媒体 X 被疯传。

几乎一夜之间,国外各大社交平台就被她大量不雅照填满,其浏览累计数千万次。

这类恶意攻击,几乎是毫无缘由的。

这次仅是因为霉霉与 NFL 橄榄球选手官宣恋情后,蛆虫一拍脑门地即兴虚构,其利用 AI 技术以球场为背景制作大量不雅照,霉霉便再次成为受害者,却毫无征兆,难以溯源,危害持久。

即使始发账号后被封禁,也无法阻止其如瘟疫般扩散。

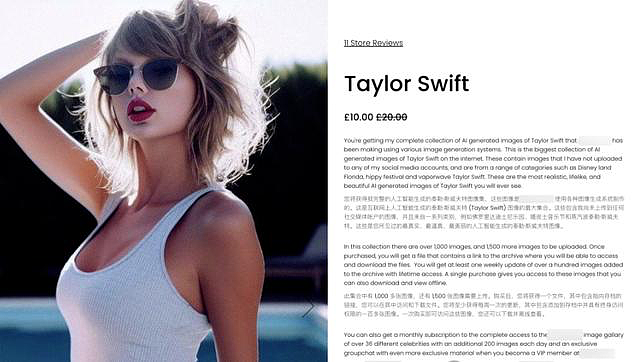

与此同时,蛆虫们仍在不断制造大量照片、视频售卖。

霉霉有庞大的粉丝群体、经济公司、法律团队帮她自证、追责,尚且如此。

整整 7 年时间里,霉霉深受其害,却屡禁不止。这一切若要落在普通人身上呢?我们是该像六子那样抛开肚子来自证清白?还是忍受着恶臭凝视,支付着高昂佣金,去走那条甚至可能找不到施暴者的维权之路呢?

主角若换成你我,可能连自证都无比昂贵且举步维艰。

事实上随着 deepfakes 开源 AI 换脸项目的代码后,国内的明星艺人同样饱受其害。

当我们在 b 站上看「有演技版」杨幂时,暗处早已蛆虫遍布。

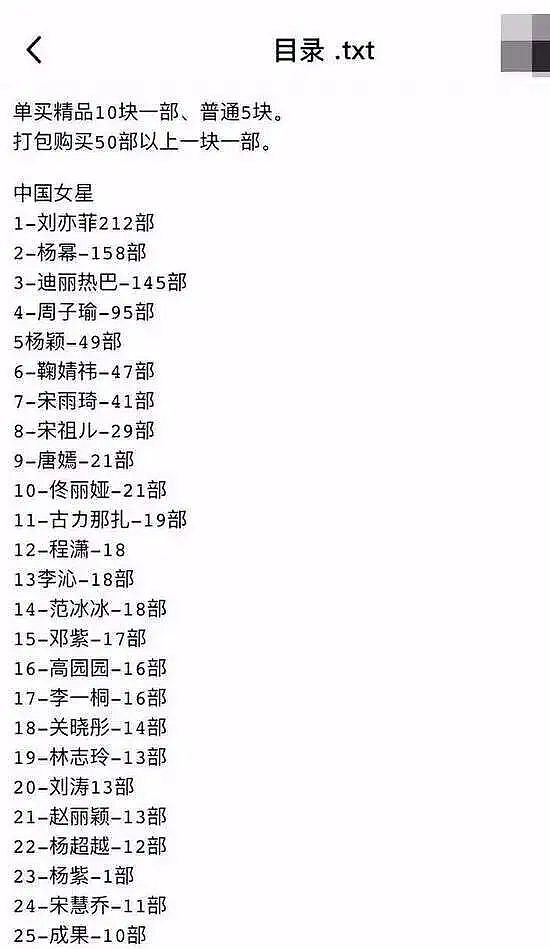

打包售卖 AI 换脸后视频、照片的恶劣行径,国内也比比皆是。

据 Sensity AI 的调查,如今 96% 的 AI 视频是女性性影像。

2018 年至 2020 年间,网络上的 AI 色情影片数量大致每六个月就会翻一倍。

2024 年 3 月全球首个深伪侵犯研讨会公开了一组数据,令人咋舌——至今全球已知的互联网 AI 伪造色情影片超 27 万条,这一数据是 2019 年的 18 倍,而这些影片的总观看次数多达 40 亿次。

这组数据中的重点词其实是「已知」,人尽皆知「已知」从来都只是互联网中的冰山一角。而这则意味着 27 万、18 倍、40 亿次这组已足够令人瞠目的数据,实则却仅是窥豹一斑。

而随着技术进步,生成 AI 色情影像的速度正越变越快,门槛也越来越低。

如此下去,我们都将有机会在网上看到自己的黄片。

时至今日,没有人能置身事外。

下面这张图,曾是去年的爆搜。

2023 年,广州某女生在小红书发布的一张正常穿着的地铁摆拍照片。

很快被人用 AI 软件一键脱衣,并迅速在全网发散。

很快热搜上就出现词条——广州地铁三号线不雅照事件、广州地铁美女露出事件

微信内,也迅速开始疯传聊天记录。

无妄之灾啊,百口难辩。

设身处地的换位思考,我很难想象当时这个女生面临着怎样的压力和处境。

虽然这件事后续有澄清,澄清包括照片来自于 AI 伪造,女生是无辜受害者等等。但这样的消息,却很少能冲上热搜。围观者只顾分享 AI 脱衣后的裸照,没有人会帮受害者分享真相。

那张裸照,却会永远留在互联网上。

这才是互联网的记忆,犹如一把扎向普通人的尖刀。

造这样的黄谣,如今几乎是无成本的。

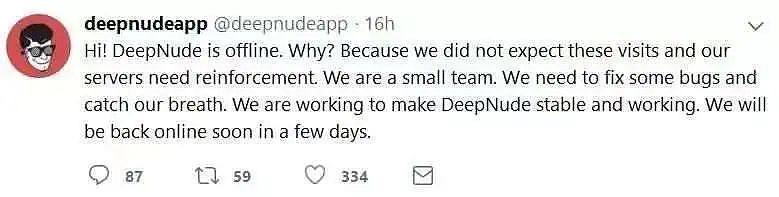

比如上图这款曾红极一时的 AI 一键脱衣 app,它甚至可以免费下载。你即使完全不懂 AI,也能迅速上手,动动手指仅需 30 秒就能实现脱衣特效。

这软件当时刚一上线,因为过于庞大的下载量一度宕机。继而无数人开始分享自己的测试成果,没错还是霉霉。但是这一次,却不只是霉霉。

不断降低的准入门槛,不断下沉的 AI 市场,迫使所有人都不得不成为 AI 色情产业的猎物。

这样一款 app,你可以可以随手上传任何一名女性。

她可以是霉霉,可以是施暴者的同班同学,可以是施暴者的身边同事,可以是施暴者坐地铁、逛街随便偶遇的一个女孩......这任何一种身份都可能是你,也可能是我。

当然这款 app 后来很快下架并宣布停运,也不会再推出新版本。

其团队还在推特上表示:我们大大低估了人们对该项目的兴趣。

但打开的潘多拉魔盒,是不会自己合上的。

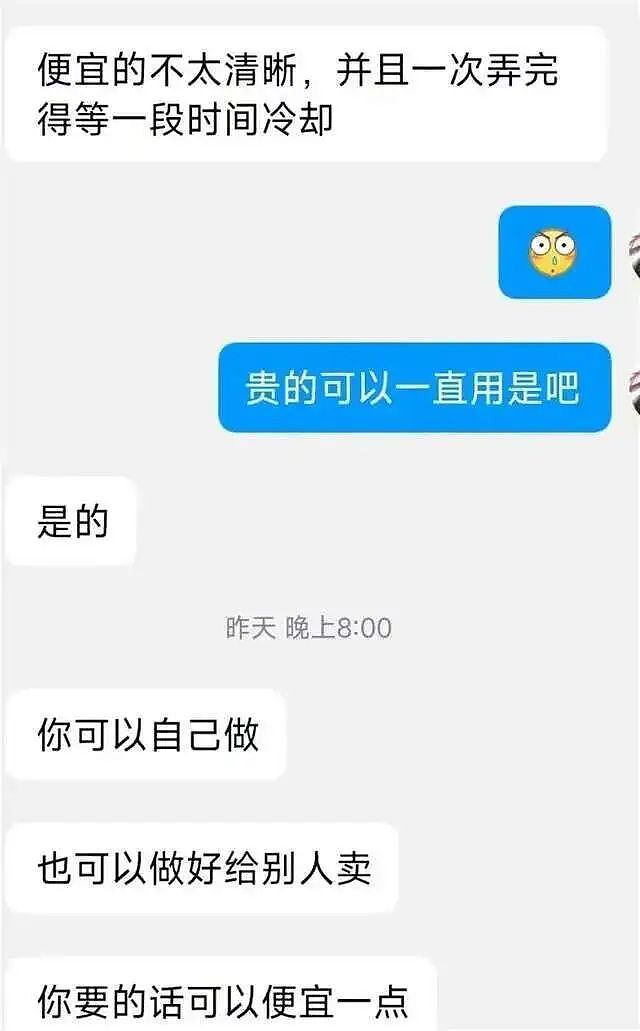

此前经记者调查,如今想要在互联网上购买到一款脱衣 app 绝非难事,甚至仅需 259 元。这些 app 操作难度甚至不及美图秀秀,仅需一键涂抹,便能将任何一张照片变成裸照。

商家还会热情提示你:你做好可以卖给别人。

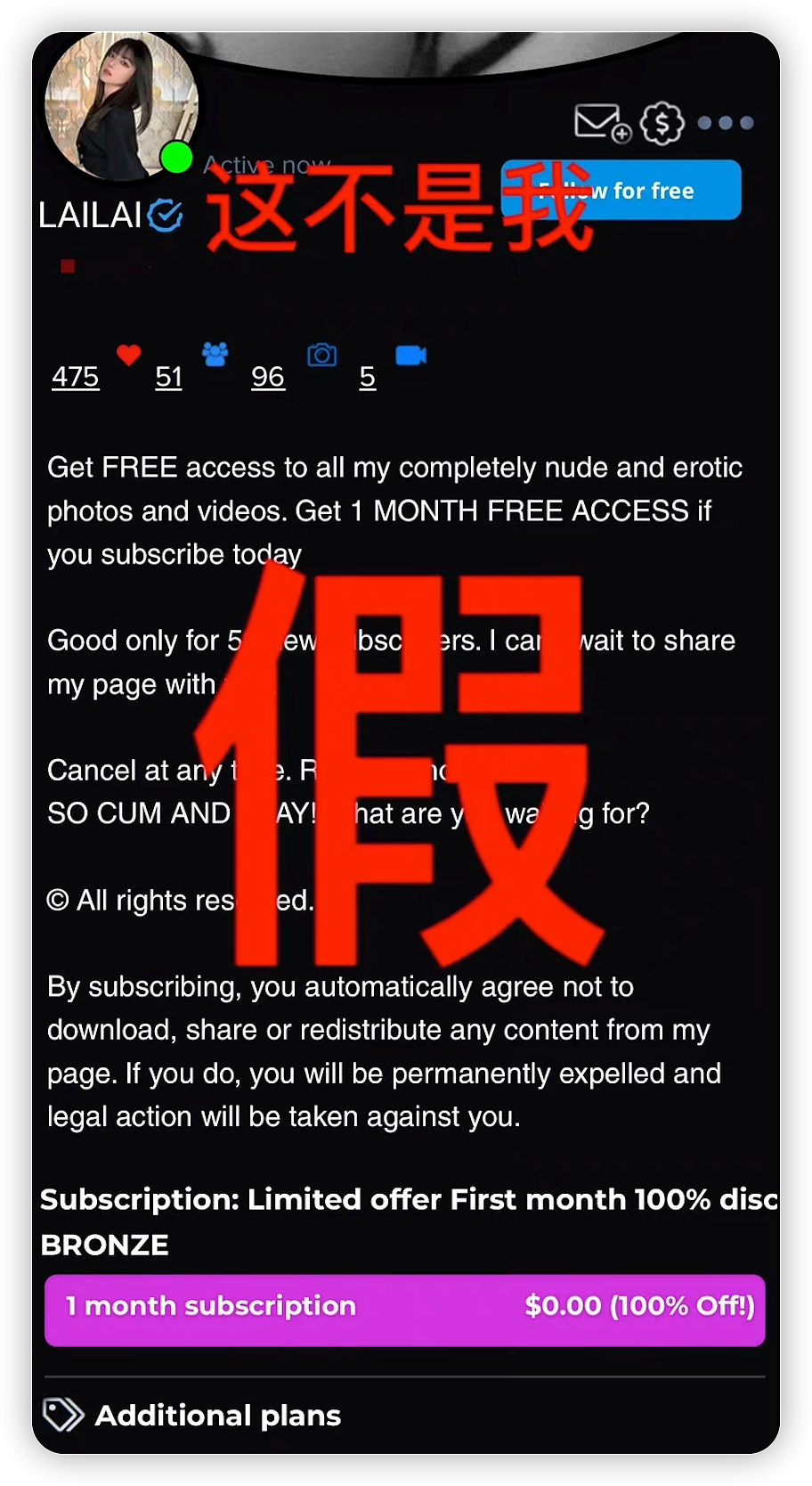

2023 年,网红博主 Caro赖赖_ 的社交账号突然涌入很多评论说:我看过你的视频。

本着清者自清的原则,她没做出任何回应。

影响却不断扩大,直至她身边的朋友发来视频询问:赖赖,这不是你吧?

看着黄片中与自己一模一样的脸,赖赖才意识到自己的「脸」被盗用生成了色情影片。与此同时,这些影片正在被疯狂传播。

视频发布者都是先在境外社交平台上注册受害者账号,再搬运其日常内容积累粉丝,紧接着以会员订阅的方式贩卖视频,形成一条完整的产业链闭环。赖赖称自己在调查过程中曾看到过一份网红名单,里面都是她熟悉的名字。

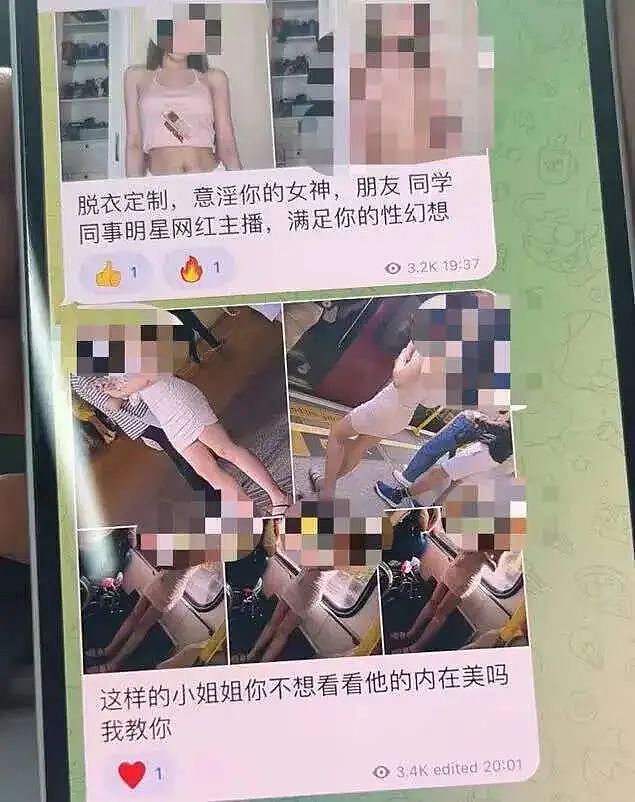

这些 AI 换脸视频售价 30-50 元,付费 200 元进 VIP 群,还能享受半价和私人定制服务。

私人定制——即提供任意一人的生活照若干,他们就能通过 AI 制成色情视频。

这些境外账号往往很难溯源,即便是溯源到,也很难将嫌疑人抓捕归案。

极其低廉的犯罪成本背面,是极高的维权成本及难度。

Twitch 平台上很多女主播不仅被 AI 换脸 P 成裸照,还被乱造黄谣。

这些博主主要靠卖身赚钱的谣言,几乎传遍全网。即便都是 AI 伪造的,但当受害人发现网络上所有人都在讨论她的裸体仍承受者巨大痛苦。

只能痛哭流涕地恳求大家不再传播:

求大家停下好吗,不要再传播这些图片了,不要再给这件事热度了,求你们了。

网络安全研究机构 Sensity 的首席科学家乔治·帕特里尼曾表示:目前已有超过68万名女性在不知情的情况下被伪造了色情图片,并上传到了公共媒体平台。

需要注意的是,这仅是被上传至公共媒体平台的数量。

不见光的暗处,这数字可能是 68 万的平方。

恰如华盛顿大学科技的 Noelle Martin 所说的:深伪色情,正在剥夺我们在世界中自主决定的权利和能力。其影响恐将贯穿一生,包括就业、收入、人际关系和亲密关系......人生的每个面向都将受其牵连。

我们正生活在一个失去隐私,且愈发不可控的时代里。

反「色情复仇」组织 Badass 的创始人说:现在每个人都有可能成为色情报复的受害者,即使没有拍过一张裸体照片,也可能会因为这项技术而成为受害者。

这把火,已然烧在你我脚下。

如今这类犯罪有多普遍呢?

2023 年 8 月 8 日,涡阳法院审结了一起传播淫秽物品罪案件。

被告人付某因贩卖、传播自制淫秽视频,被判处有期徒刑七个月,追缴违法所得 3940 元。

被告人付某平时喜欢刷短视频,一次在刷短视频的时候刷到 AI 换脸的视频,出于好奇,随便找了个网站和论坛,自学了一个月的剪辑和换脸技术,便开始熟练制作并贩卖该类视频。

无独有偶,三个月后,杭州市萧山区人民法院同样审结一起制作、传播淫秽物品牟利罪案件。

判决被告人虞某被判处有期徒刑七年三个月,并处罚金6万元。

虞某同样只是通过互联网,自学 AI 换脸的技术软件,并在掌握这项技能后开始以此牟利。

据虞某供述,为吸引更多的关注和流量,他在社交软件上创建了浏览群和私人定制群。

通过浏览群传播 AI 换脸的淫秽视频吸引、招揽观看者,再将有定制换脸的需求客户引入私人定制群。他再根据时长,视频的难度大小收取相应的费用。

虞某声称:只要能看到脸的都能换。

据检察机关了解,虞某的客户要求定制的对象不仅包括公众人物,也有生活中的普通人。对于这些未经同意就擅自侵犯他人敏感信息的违法行为,虞某向来都是来者不拒。

虞某除定制化的换脸服务外,甚至还授课。

并将 AI 换脸软件分为初级、中级和高级三个等级进行销售并传授使用教程,同时还提供网上非法收集的他人人脸素材。

在庭审中,检察机关出示了虞某侵犯公民个人信息、损害社会公共利益的详细证据,其中就有淫秽视频1200多部、图片1600多张等电子数据。

看到了吗,这就是你我身边发生过或正在发生的案例。

这样的侵犯和强奸,几乎无处不在。

你的厨房里,永远不会只存在一只蟑螂。当你发现一只蟑螂时,就注定意味着暗处已经抱窝了,这些垃圾人也是同理。正在我们还没看见的角落里,隐性的性侵和强奸正无处不在,蛆虫们正抱团狂欢。

正如 N 号房事件,打掉一个 N 号房并不意味着结束。

N 号房有消失过吗?

刚刚庭外和解的黄子佼,被曝出性侵后,检警在他个人硬盘里发现了上百部少女影像。这些影像有未成年少女被逼学狗爬,被针刺身体等,施暴者甚至要求她们举着身份证,证明自己是未成年。

这些全都是黄子佼在过去 6 年(2017年开始)内从台版 N 号房买的,他还是高级会员。

任何这类犯罪,都是同理。

这篇文章写到最后,其实是有点不知所措的。

因为偷拍、迷奸......等过去一系列犯罪,我们都还有办法、措施保护自己。

但面对 AI 强奸,我们却无计可施。

难道应该彻底拒绝拍照吗?还是干脆不出门?或者整日裹着厚厚的头巾......

我们也许只是发条朋友圈,都会成为新素材。

我们总说技术没错,错的是人。

但是作为受害者,或者可能被施暴的人群,又该怎么做呢?

技术进步的实在太快,日新月异,我们却变得更危险。

除了呼吁技术壁垒更完善,法律更健全,以及溯源、追捕更迅速以外我们无计可施。

我们无一不生活在,随时有可能被换脸成黄片主角的环境中。

这件事本身,是不应该的。

+61

+61 +86

+86 +886

+886 +852

+852 +853

+853 +64

+64